Altersbeschränkung für KI?

Die Politik debattiert über Social-Media-Verbote für Kinder – und übersieht KI-Chatbots. Dabei sind deren Risiken für die kindliche Entwicklung mindestens ebenso gravierend.

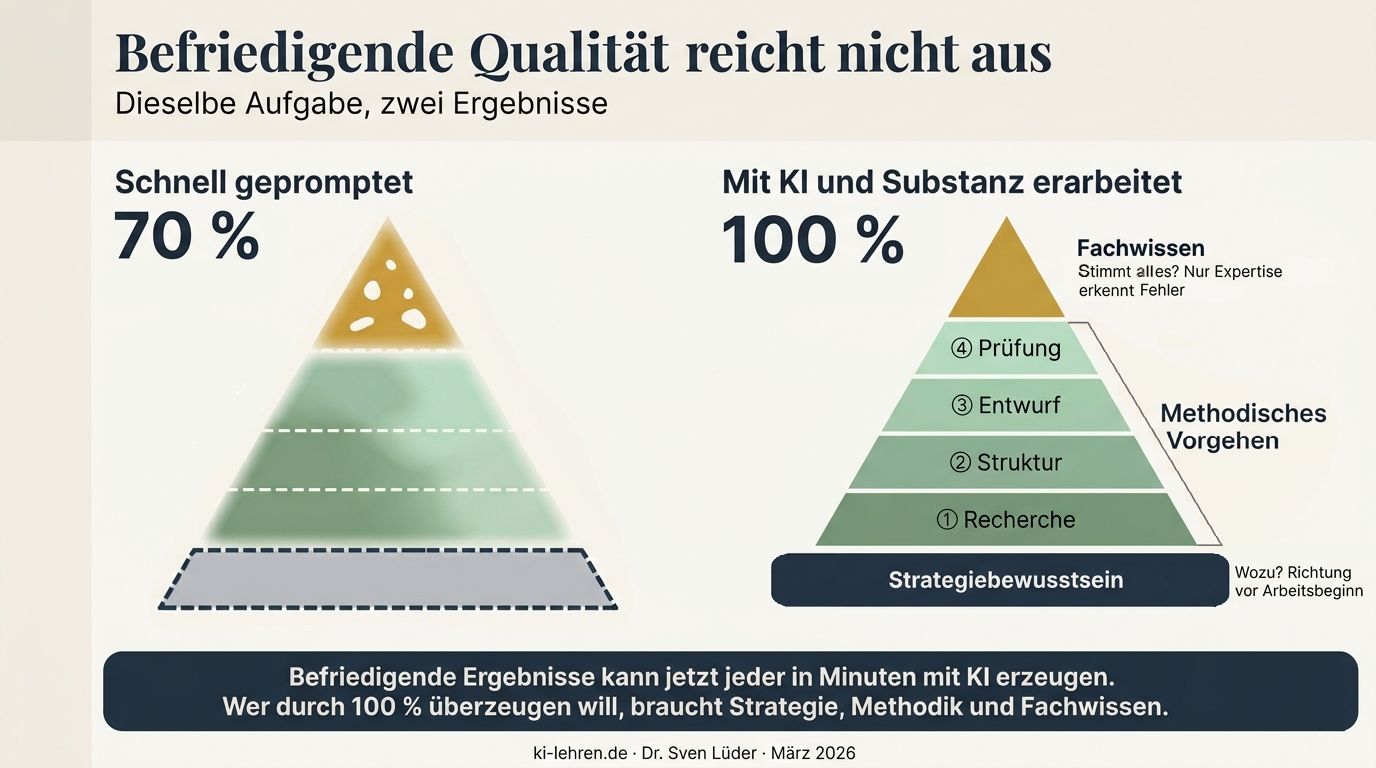

Artikel lesenWer mit KI-Chatbots arbeitet, kennt vielleicht das Erlebnis: In fünf Minuten entstehen Ergebnisse, die, weil sie sprachlich solide und nett anzuschauen sind, auf den ersten Blick überzeugen – bei genauerer Betrachtung aber nur etwa 70 Prozent dessen darstellen, was ein wirklich gutes Ergebnis wäre. Für die restlichen 30 Prozent – inhaltliche Präzision, ein Bewusstsein für den konkreten Kontext und eine klare Ausrichtung auf das eigentliche Ziel – braucht man ein Vielfaches an Zeit und Denkarbeit. Und schon der erste Entwurf muss tragfähig sein, sonst erreicht man auch mit noch so vielen Iterationen keine wesentlichen Verbesserungen mehr.

Befriedigende Ergebnisse kosten fast nichts mehr, werden dadurch, dass sie nun jeder schnell erzeugen kann, aber auch stark entwertet. Was braucht es also, um darüber hinauszugehen?

Dass Darstellungsqualität und inhaltliche Tiefe auseinanderklaffen, ist kein neues Phänomen. In Schule und Hochschule gab es schon vor dem Einzug von KI Schüler*innen und Studierende, die brillant präsentierten, ohne ein Thema wirklich durchdrungen zu haben. KI potenziert dieses Problem, weil sie die Darstellungsseite für praktisch jeden verfügbar macht. Wer einen sprachlich einwandfreien Text vorlegt, beweist damit nun keineswegs, dass er das Thema verstanden hat (häufig macht er sich, im Gegenteil, sogar des Betrugs verdächtig).

Eine Studie der Cornell University und der UC Berkeley (Kusumegi et al., Science, Dezember 2025; Zusammenfassung im Cornell Chronicle) bestätigt das empirisch für Forschungsergebnisse: Wissenschaftler*innen, die LLMs nutzen, publizieren 30 bis 50 Prozent mehr, doch die sprachliche Qualität entkoppelt sich dabei von der wissenschaftlichen Substanz. Gut formulierte, aber KI-verfasste Arbeiten hatten schlechtere Chancen auf Annahme in Fachzeitschriften – die Gutachter*innen erkannten offenbar, dass sprachliche Glätte keinen inhaltlichen Wert garantiert. Für den Bildungskontext verschärft sich dieses Muster: Wenn Schüler*innen KI-generierte Texte abgeben, wird die glatte Oberfläche zur Maske für fehlendes Verständnis – ein Problem, das ich im Artikel über Vertrauensverlust durch KI aus der Perspektive der Lehrkräfte beschrieben habe.

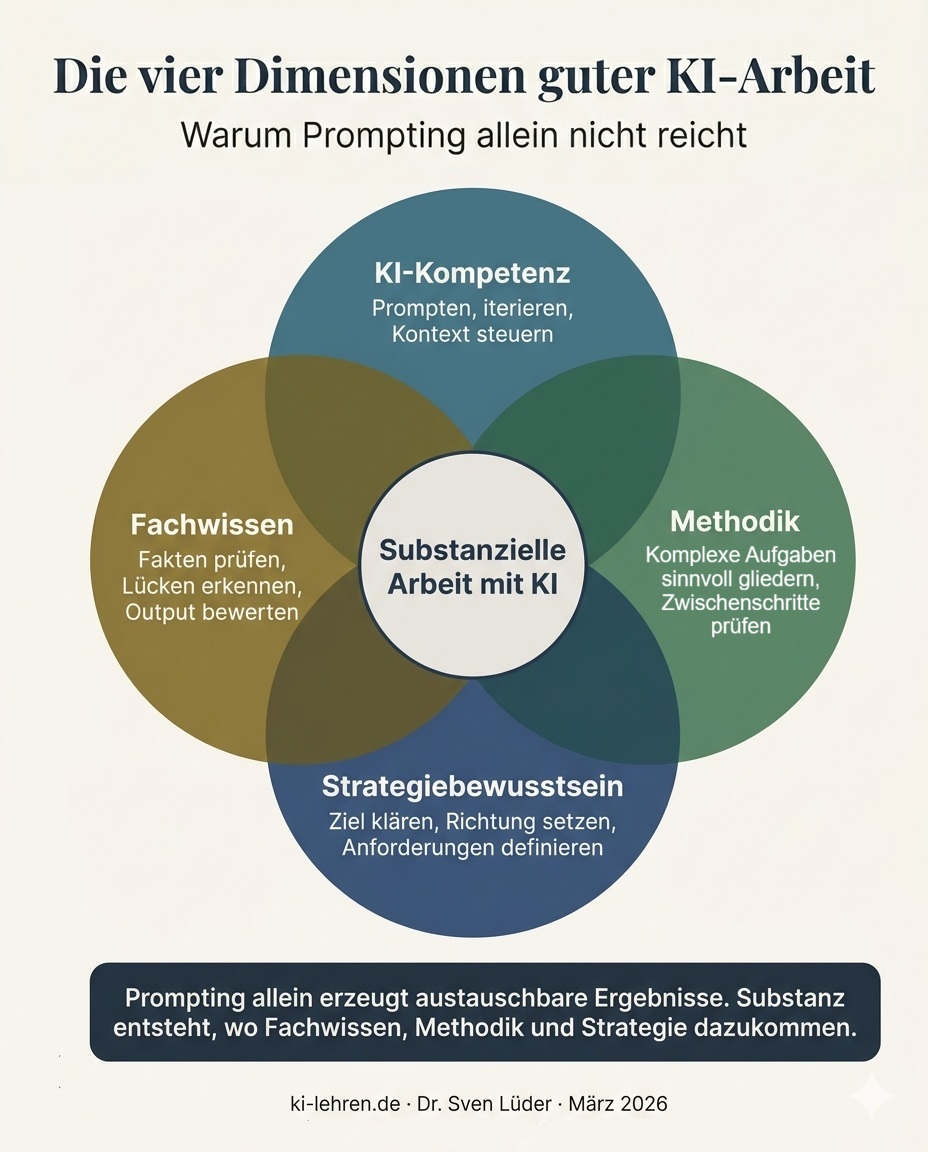

Das verbreitete Missverständnis besteht darin, KI-Kompetenz für die einzige noch relevante Fähigkeit zur Erledigung vieler Aufgaben zu halten. Was ein 70-Prozent-Ergebnis von einem substanziellen Ergebnis trennt, lässt sich aber erst im Zusammenspiel von vier Dimensionen beschreiben.

Ich erkläre diese Dimensionen im Folgenden anhand eines einfachen Beispiels: Jemand möchte eine Präsentation zum Thema „Auswirkungen von KI auf den Arbeitsmarkt" erstellen.

KI-Kompetenz bedeutet nicht nur strukturiertes Prompten, sondern umfasst auch reflektiertes Iterieren und vor allem die Fähigkeit, den Kontext gezielt zu steuern – also der KI die richtigen Informationen, Rollen und Einschränkungen mitzugeben, damit sie nicht ins Blaue generiert. Wer glaubt, ein einzelner gut formulierter Prompt würde genügen, wird zunehmend generischen Output erzeugen. Im Beispiel: Wer weiß, wie man der KI Zielgruppe, Vorwissen des Publikums und den gewünschten Argumentationsstrang als Kontext mitgibt, erhält ein grundlegend anderes Ergebnis als jemand, der nur tippt: „Erstelle eine Präsentation zu KI und Arbeitsmarkt."

Fachwissen. KI modelliert statistische Wahrscheinlichkeiten, keine Wahrheit. Ohne Sachkenntnis lässt sich nicht beurteilen, ob ein Ergebnis korrekt ist oder ob es nur überzeugend klingt. Ethan Mollick beschreibt die Leistungsgrenzen von KI als „jagged frontier", also als gezackte Grenze: Nur wer das Fachgebiet beherrscht, erkennt, wo die Grenze zwischen Zuverlässigkeit und Halluzination im konkreten Fall verläuft. Eine KI erzeugt in Minuten eine plausibel klingende Präsentation – ob die genannten Arbeitsmarktdaten aktuell sind, ob die Gewichtung von Automatisierungsrisiken dem Forschungsstand entspricht und ob die Argumentation einer kritischen Nachfrage standhält, erkennt nur, wer sich auskennt.

Methodisches Vorgehen: die Fähigkeit, eine komplexe Aufgabe in die richtigen Arbeitsschritte zu zerlegen und die Qualität jedes einzelnen Schritts zu kontrollieren. Wer die KI mit einem einzigen Prompt beauftragt, überfordert das System mit einer Aufgabe, die Recherche, Strukturierung, Formulierung und Gestaltung zugleich verlangt, und bekommt entsprechend generischen Output. Wer den Prozess hingegen in Teilschritte zerlegt – zuerst recherchieren und die Kernthese erarbeiten, dann die Argumentation strukturieren und schließlich über die visuelle Umsetzung entscheiden –, kann die KI bei jedem einzelnen Schritt einsetzen, das Zwischenergebnis prüfen und so für eine tragfähige Grundlage im nächsten Schritt sorgen.

Strategiebewusstsein: das Wissen darum, welchem übergeordneten Ziel eine konkrete Aufgabe dient. Strategiebewusstsein muss der Erarbeitung einer einzelnen Aufgabe vorausgehen, weil es bestimmt, in welche Richtung gearbeitet wird. KI optimiert auf den Prompt, nicht auf den impliziten Zweck. Dieselbe KI kann zehn verschiedene Präsentationen zum selben Thema erzeugen, die alle strukturell funktionieren – welche davon für dieses Publikum, diesen Anlass und dieses übergeordnete Ziel die richtige ist, lässt sich nur beantworten, wenn man die eigene Strategie kennt. Soll die Präsentation zum Handeln auffordern? Soll sie kritisches Denken an Arbeitsmarktprognosen schulen? Oder soll sie die Frage aufwerfen, welche Kompetenzen nicht automatisierbar sind? Jede Antwort führt zu einem anderen Ergebnis, und keine davon ergibt sich aus dem Prompt allein.

Es liegt nahe, KI-Kompetenz als isolierte Fertigkeit zu unterrichten: prompten lernen, Output generieren. Das produziert aber nur 70-Prozent-Ergebnisse. Fachwissen, methodisches Vorgehen und Strategiebewusstsein waren immer Kern guter fachlicher Ausbildung. Im Zeitalter von KI werden sie noch wichtiger, weil sie die Differenz zwischen austauschbarem Output und substanzieller Arbeit bestimmen.

Für den Unterricht heißt das: KI-Kompetenz darf nicht ohne die fachlichen, methodischen und strategischen Voraussetzungen vermittelt werden, die gute Ergebnisse erst ermöglichen. Wer Schüler*innen beibringt, wie man promptet, ohne ihnen beizubringen, wie man Ergebnisse beurteilt, zerlegt und strategisch einsetzt, bildet Konsument*innen von Mittelmaß aus. Die didaktische Aufgabe besteht darin, alle vier Dimensionen gezielt zu entwickeln und KI erst dann einzusetzen, wenn das Fundament steht.

KI als Kulturtechnik zu begreifen heißt gerade nicht, sie auf Bedienung zu reduzieren. Auch Lesen und Schreiben sind Kulturtechniken und niemand würde behaupten, dass Alphabetisierung allein gute Texte garantiert. 70 Prozent kann jetzt jeder. Bildung entscheidet darüber, wer die 100 erreicht.

Über Mittelmaß hinaus: In den Workshops auf ki-lehren.de erarbeiten wir gemeinsam, wie Sie KI so einsetzen, dass Fachwissen, methodisches Vorgehen und Strategiebewusstsein den Unterschied machen – in Ihrer eigenen Arbeit und im Unterricht mit Ihren Schüler*innen.

© Sven Lüder, www.ki-lehren.de

Die Politik debattiert über Social-Media-Verbote für Kinder – und übersieht KI-Chatbots. Dabei sind deren Risiken für die kindliche Entwicklung mindestens ebenso gravierend.

Artikel lesenLLMs reproduzieren Ideen aus Quellen, die sie nicht immer nennen. Wer KI-kuratiert oder -generiert arbeitet, riskiert daher unbeabsichtigte Übernahmen und gleichförmige Ergebnisse.

Artikel lesenDie binäre Frage „mit oder ohne KI“ wird der Realität nicht gerecht. Mithilfe eines Stufenmodells lässt sich die KI-Beteiligung präzise angeben. Gerade in der Bildung braucht es eine transparente Terminologie.

Artikel lesen